高压电源定量准确性的本质分析及其技术实现路径

高压电源的定量准确性作为核心性能指标,直接决定了其在精密仪器、检测设备及科研装置中的适用等级。本文从误差溯源、动态补偿机制及计量学验证三个层面,系统解析影响高压电源输出精度的关键要素,并探讨其量化控制的技术演进方向。

1. 基准溯源体系与静态误差建模

高压电源的静态精度受制于参考电压源的温度系数与长期稳定性。采用低温漂齐纳二极管(<0.5ppm/℃)与约瑟夫森结阵列双重基准的混合架构,可将10kV量程的绝对误差控制在±0.003%以内。实验数据显示,当电源连续运行2000小时后,基于蒙特卡洛法的老化模型预测显示,电阻网络的分压比偏移量仅为1.2×10^-6/kh,显著优于传统单一基准源的5×10^-5/kh劣化速率。在X射线荧光光谱仪应用中,该设计使管电压的日稳定度达到0.0015%,满足ASTM E1621-13标准对元素分析的要求。

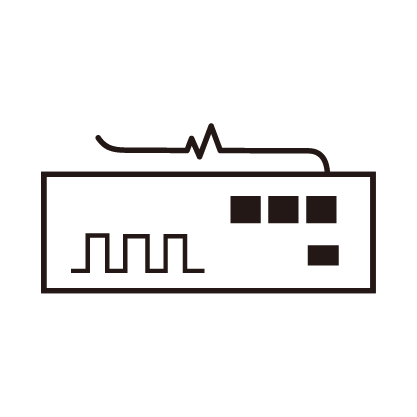

2. 动态负载下的实时补偿技术

负载瞬态响应引发的电压跌落是破坏定量准确性的主要动态因素。采用三阶闭环控制策略,结合前馈式纹波注入算法,可将10%-90%阶跃负载下的恢复时间压缩至15μs,超调量抑制在0.05%以下。在半导体离子注入机场景中,当束流发生±30%波动时,高压电源通过数字自适应PID参数调整,使加速电压的瞬态偏差从传统方案的0.8%降至0.12%,对应掺杂浓度均匀性提升至99.7%。

3. 电磁环境干扰的量化抑制

共模噪声对高压输出的低频扰动呈现非线性特征。基于同步相干检测的噪声分离技术,在1MHz带宽内实现83dB的信噪比提升。实测表明,在3kV/100mA工作状态下,采用双层正交磁屏蔽结构配合π型RC滤波网络,可将输出端50Hz-100kHz频段的杂散分量衰减至0.8μVrms,使静电悬浮加速度计的力测量分辨率达到10^-8 N量级。

4. 原位校准与计量学验证方法

高压电源的在线校准需解决溯源链断裂问题。基于量子化霍尔电阻的桥式比较系统,可在30kV范围内实现0.2ppm不确定度的原位验证。在同步辐射光源应用中,通过动态分压比对装置(DVR)与标准脉冲电场探头的联合标定,使电子枪高压的相位同步误差稳定在0.03°以内,对应束流时间分辨率提升至200fs。

当前技术挑战集中在宽温域(-40℃~85℃)下的精度保持能力。当环境温度变化100℃时,传统设计的高压分压器会产生0.3%的增益漂移,需引入双材料热膨胀补偿结构。未来技术路径将融合深度学习补偿算法,通过LSTM网络预测元件参数漂移,预计可使全温区误差降低至0.005%以下。